(中央社訊息服務20230630 17:00:22)生成式AI應用爆發式成長與網紅小玉案判決的影響下,AI生成內容(AI Generated Content, AIGC)可能產生不實資訊的議題持續發酵。資策會科技法律研究所(科法所)長期關注國內外AI相關政策與監管動態,協助推動AI治理。

深偽技術盛行下製造不實資訊比過去更加容易,任何人皆可透過AI應用做出以假亂真的影像,加上網路傳播資訊便利,使得可能侵權的不實資訊氾濫成災。針對深偽技術不實資訊製作、傳播或銷售等行為增修立法的議題,多數意見認為基於技術中立原則,應先評估現行法是否足以因應新興科技,並發布相關指引作為配套。

中國大陸於2022年11月發布了《互聯網信息服務深度合成管理規定》,成為極少數對深偽技術進行專法監管的國家。此外,試圖設立專法的國家中,美國聯邦立法因憲法增補條款第1條保障的言論自由,及著作權法合理使用等質疑聲浪下進展緩慢,迄今僅少數州自2019年起立法通過打擊深偽技術在政治和性方面的不實資訊。

面對AI帶來的機遇與風險,資策會科法所法律研究員柯郁萱觀察,如深偽技術等AI風險議題,國際間對於是否應對AI採取全面性監管仍有所分歧,支持者表示立法可確保AI可信度降低危害風險;反對者則認為監管將扼殺AI發展機會,應制定不具強制力的指引引導公私部門使用AI技術。因應國際間對AI治理分歧,2023年5月舉行的廣島G7峰會中,與會國承認各國對規範AI的立場不同,然而考量生成式AI的急迫性,G7峰會聯合聲明將責成相關部長建立「廣島AI進程」(Hiroshima AI process)以討論不實資訊等AI議題,為產業發展建立可互通的AI治理架構。

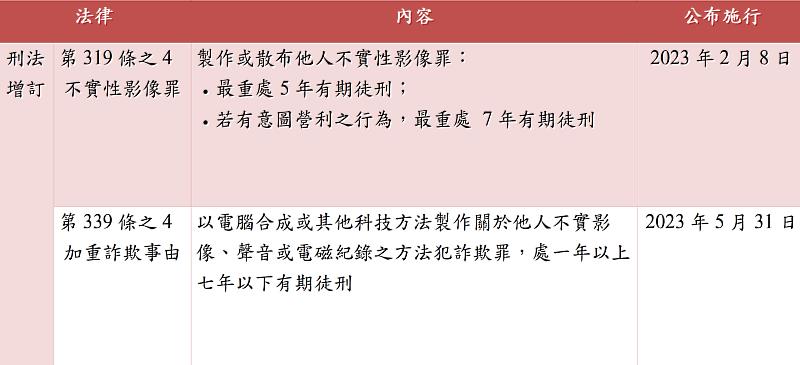

臺灣於2023年通過增訂刑法第319條之4「不實性影像罪」,及第339條之4不實影像、聲音或電磁紀錄的加重詐欺罪事由,望遏止以電腦合成方式(例如:深偽換臉技術)的性暴力及打擊詐騙犯罪行為。除透過增修現有法規以解決新興科技特定風險外,臺灣應緊隨國際腳步,建立適合AI發展的原則性規範,並可制定不同面向的AI指引供公務機關與產業遵循,資策會科法所也將持續協助政府與企業推動AI治理。

【資策會科技法律研究所官網】 https://stli.iii.org.tw/

【新聞聯絡人】 資策會科法所 顏翩翩 Tel: (02) 6631-1084 Email: [email protected]