CNEWS匯流新聞網記者胡照鑫、王佐銘/台北報導

MIC第37屆春季研討會,今(17)日上午針對「AI發展趨勢與治理」進行分享,資策會科技法律研究所副主任陳譽文表示,受規範的AI系統範圍逐漸形成共識,OECD去年11月底提出對AI系統的定義,反映出國際監管對象是對周遭環境具有適應性的AI系統,今年歐盟及聯合國作出相關決議,凸顯AI監管治理的急迫性。

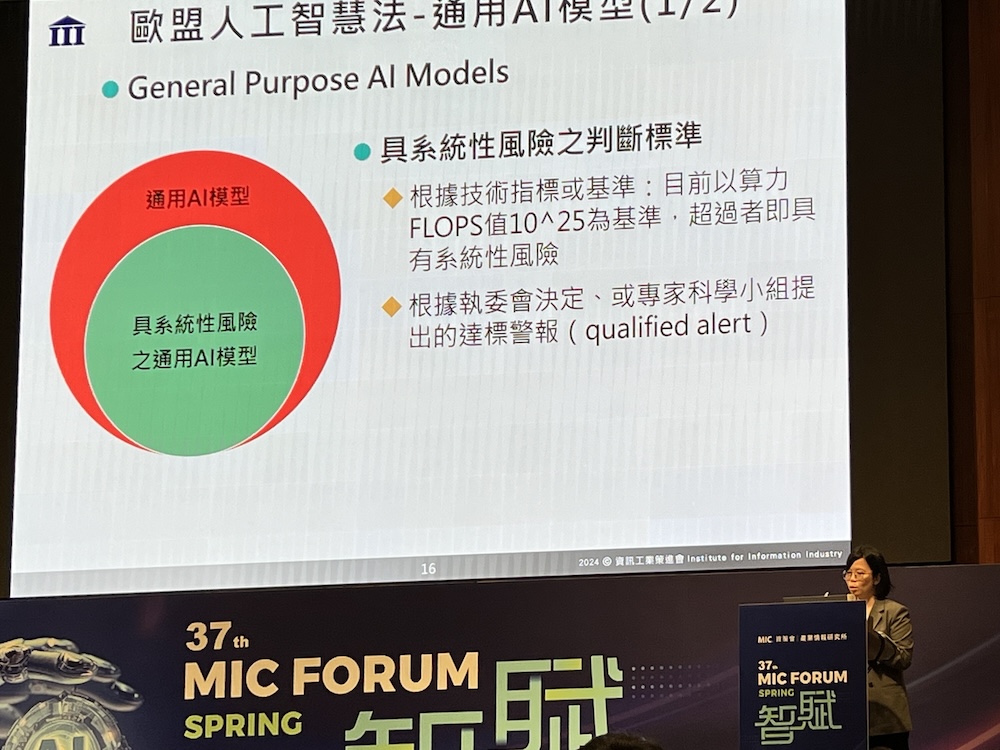

國際上的重要AI治理事件,從2021年歐盟的AIA草案開始,到去年G7的「廣島AI進程」,對於AI開發者的國際指導方針及更具體計畫行動達成共識,達成AI開發者的行為準則,加上英國AI安全高峰會發表「布萊切利宣言」,重申國際合作的重要性,並提出AI監管核心價值。今年則有歐盟人工智慧法通過,依據不同方顯建立四個不同的監管等級,並且納管通用AI,聯合國並作出AI決議,制定安全使用人工智慧的原則。

陳譽文分享,歐盟人工智慧法是以風險為基礎的監管途徑,將分階段執行,除了規範AI價值鏈參與者責任,更列出禁止使用具不可接受風險的AI系統;此外,對於高風險、有限風險AI及通用AI模型也都作出定義及責任。歐盟人工智慧法還定出多項罰則,包括違反禁止的AI行為規定,最高可罰三千五百萬歐元,違反其他AI系統規定最高可罰一千五百萬歐元等。

對於生成式AI生成的內容,生成式AI能否適用資料探勘的合理使用?陳譽文認為,還是要盡量取得授權才能避免爭議,AI與著作權法涉及層面廣泛,如何在保護著作權人利益與AI產業發展間取得平衡,需要觀察各國的著作權議題發展,可作為國內政策方向定錨參考。

個資隱私一直是AI討議題中十分受關注的重點,利用人工智慧的犯罪及假訊息行為同樣受到重視。陳譽文表示,系統安全性直接影響到AI是否被信任和廣泛應用,尤其當AI系統的決策導致消費者損害時,確定責任方並不容易,未來法規需要明確AI系統的開發商、部署者及其他人等在何種情況下承擔責任,以及消費者如何獲得賠償。

陳譽文表示,強而有力的治理行為有其必要,包括人工智慧的開發、部署和使用的培訓及明確政策;需要確保人工智慧系統在啟動前,經過徹底的測試和驗證;此外,要清楚記錄人工智慧的設計、操作和限制,並且監控AI的性能和錯誤,包括任何潛在偏見,做好更全面的治理,才能讓AI成為更安全的工具。

照片來源:CNEWS匯流新聞網資料照

《更多CNEWS匯流新聞網報導》

資安不容忽視!生成式AI加速網攻進程 2023身分詐欺TOP5曝光

生成式AI深入生活各層面 MIC:準備好未來與生成式AI共處

【文章轉載請註明出處】